0.环境说明:

①Ollama介绍:

Ollama是一款开源、轻量级的本地大模型运行工具,支持跨平台一键部署,让用户无需编程经验也能在个人电脑上安全、高效地运行和管理主流AI模型,有效保障数据隐私 。

当前流行模型一览:

①配置要求:

| CPU | 2CORE |

| RAM | 4GB |

| Disk | 10GB |

| 操作系统 | LINUX_X86-64 |

| 端口开放 | 11434 |

1.Docker Compose 方式安装ollama

配置docker-compose文件:

mkdir ollama #建立存放目录

vi docker-compose.yml #编辑docker-compose文件

写入以下内容:

version: '3.8'

services:

ollama:

image: ollama/ollama:latest

container_name: ollama

ports:

- "11434:11434" # 标准端口

- "21434:21434" # 可选API端口

volumes:

- ./ollama_data:/root/.ollama # 模型持久化存储

- /etc/localtime:/etc/localtime:ro # 时区同步

environment:

- OLLAMA_HOST=0.0.0.0 # 允许外部访问

- OLLAMA_KEEP_ALIVE=24h # 模型驻留时间

- OLLAMA_NUM_PARALLEL=4 # 并行请求数

- OLLAMA_GPU_LAYERS=999 # GPU加速层数(NVIDIA需配置)

- OLLAMA_CONTEXT_LENGTH=4096

- OLLAMA_FLASH_ATTENTION=true

deploy:

resources:

limits: # 硬性限制(必须满足)

cpus: "6" # 最多使用6个CPU核心(如50%)

memory: 6888M # 最大内存6888MB

reservations: # 软性预留(最低保障)

cpus: "2" # 至少分配2个CPU核心

memory: 2048M # 至少预留2048MB内存

restart: unless-stopped

networks:

- llm_network

networks:

llm_network:

driver: bridge

保存后启动容器

docker-compose up -d

2.拉取模型到本地

①进入容器,拉取模型:

进入容器

docker exec -it ollama bash

拉取模型,这里举个几个例子,实际情况可以根据配置自行选择

ollama pull gemma3:4b

ollama pull qwen2.5-coder:1.5b

ollama pull deepseek-r1:1.5b

ollama pull llama3.2:latest

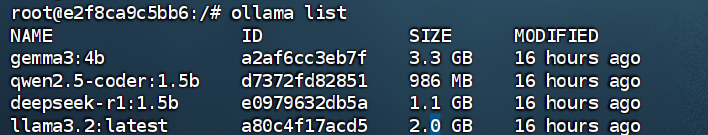

②检验模型:

检验模型是否拉取成功,容器内执行:

ollama list

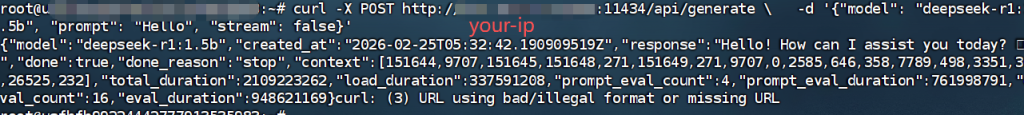

测试模型

# 测试 deepseek 模型

curl -X POST http://your-ip:11434/api/generate \

-d '{"model": "deepseek-r1:1.5b", "prompt": "Hello", "stream": false}'

这里的“your-ip”可以使用宿主机IP或者ollama容器IP

返回结果参考:

3.其它

①模型配置要求:

②Docker Compose 部署openclaw并接入本地模型的方式:

1 ping

[…] Docker Compose 方式快速部署Ollama 本地部署大模型 […]